AI는 이젠 모델이 아니라 시스템으로 무게중심이 옮겨지고 있다. | 매거진에 참여하세요

AI는 이젠 모델이 아니라 시스템으로 무게중심이 옮겨지고 있다.

#agenticAI #흐름 #방향 #AI #보고서 #AI+HW 2035 #Shaping th

요즘 AI를 보면서 이상한 느낌이 있다.

분명히 모델은 계속 좋아지고 있다. 새로운 모델이 나올 때마다 성능은 올라가고, 할 수 있는 일도 늘어난다.

그런데도 어딘가에서 묘한 느낌이 든다. 예전처럼 “와, 완전히 달라졌다”는 충격은 점점 줄어들고 있다는 점이다.

전단계대비 , 조금더 업그레이드되는 느낌이지, 완전히 다르다라는 느낌이 적어진다.

처음에는 이걸 단순하게 받아들였다.

이제 어느 정도 한계에 가까워진 게 아닐까, 모델이 충분히 커질 만큼 커졌고 더 이상 큰 도약은 어려운 단계에 들어온 게 아닐까 하는 생각이었다.

그런데 이 생각이 완전히 맞는 것 같지는 않았다.

왜냐하면 모델 자체는 여전히 개선되고 있기 때문이다.

코드 생성은 더 정확해졌고, 문맥 이해도는 더 길어졌으며, 다양한 작업을 동시에 처리하는 능력도 계속 좋아지고 있다.

성능이 멈춘 것이 아니라, 우리가 체감하는 방식이 바뀌고 있는 것에 가깝다.

이 지점에서 하나의 논문을 보게 됐다. AI가 지속적으로 발전되려면 어떻게 바뀌어야 하는가?

AI+HW 2035: Shaping the Next Decade

https://arxiv.org/pdf/2603.05225.pdf

1. 전체 흐름은 다음과 같다.

구분 | 기존 AI 패러다임 | 현재 문제 | 논문의 변화 제안 | 결과 |

|---|---|---|---|---|

중심 | 모델 | 시스템 병목 | 시스템 중심 | AI = 시스템 |

목표 | 성능 (accuracy) | 비용 폭발 | 효율 (efficiency) | 지속 가능 |

방식 | scaling (크기 증가) | 전력/메모리 한계 | 구조 재설계 | 새로운 scaling |

단위 | 단일 모델 | 복잡한 워크로드 | 통합 시스템 | 분산 구조 |

2. Scaling 개념이 단순히 컴퓨팅에서 효율화로 변화한다.

항목 | 기존 | 변화 |

|---|---|---|

핵심 지표 | 파라미터 수 | Intelligence per Joule |

방법 | 모델 크기 증가 | 효율 최적화 |

접근 | Compute 중심 | System + Energy 중심 |

결과 | 성능 증가 | 성능 + 비용 균형 |

3. 병목은 GPU가 아니라 메모리다.

영역 | 기존 인식 | 실제 병목 (논문) |

|---|---|---|

연산 | GPU 성능 부족 | 상대적으로 덜 중요 |

메모리 | 보조 요소 | 핵심 병목 |

데이터 이동 | 무시됨 | 비용의 대부분 |

전력 | 부차적 문제 | 가장 중요한 제약 |

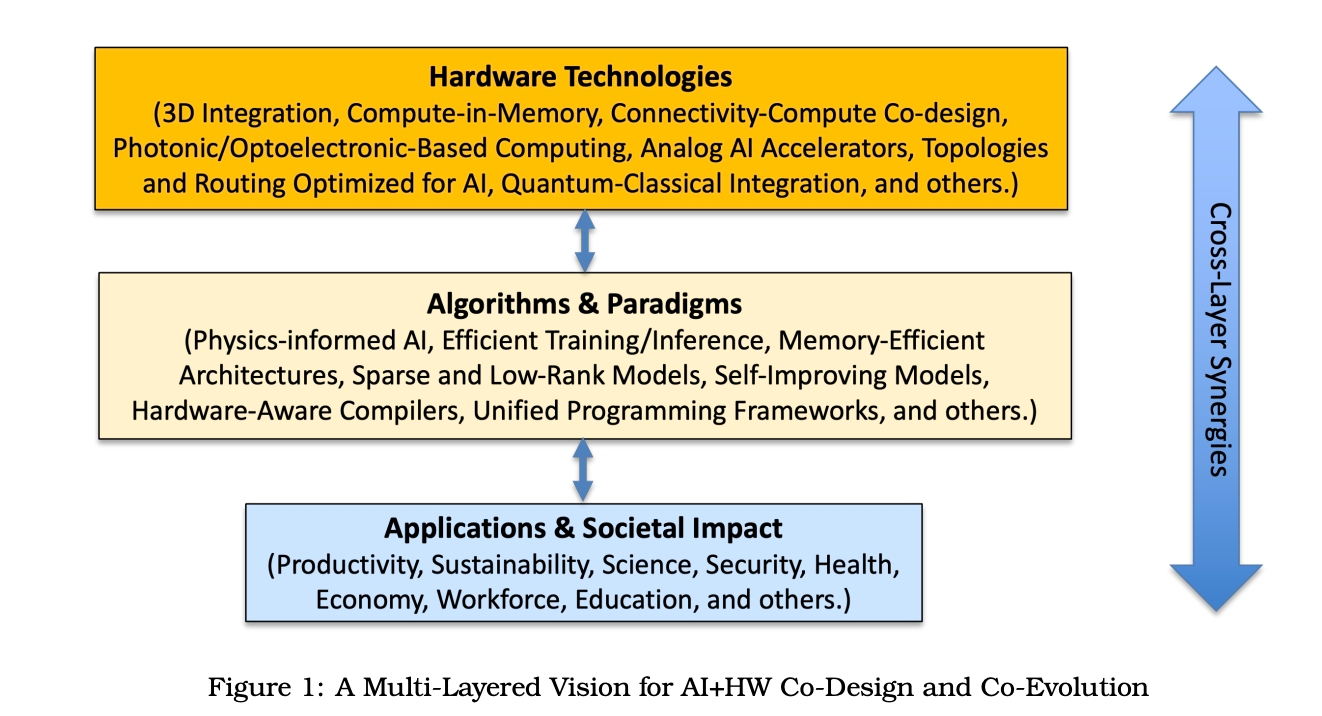

4. 단순히 각각 발전시키는 것이 아니라, 통합적인 발전이 필요하다.

전략 | 설명 |

|---|---|

Cross-layer optimization | 알고리즘~하드웨어까지 통합 최적화 |

Co-design | 모델 + 칩 + 시스템 함께 설계 |

System-level AI | cloud + edge + device 통합 |

Energy-aware computing | 전력 기반 최적화 |

5. 기존의 방식은 왜 한계인가?

문제 | 설명 |

|---|---|

전력 한계 | 데이터센터 전력 소비 급증 |

메모리 병목 | 데이터 이동 비용 > 연산 비용 |

비용 증가 | scaling 대비 효율 급감 |

구조 분리 | 모델/하드웨어 따로 최적화 |

지금까지 우리가 당연하게 생각해왔던 AI 발전의 방식 자체를 다시 묻는다.

이 논문이 던지는 메시지는 꽤 직설적이다.

앞으로 AI의 핵심은 더 높은 성능이 아니라, 더 높은 효율이라는 것이다.

이 말은 처음 들으면 약간 어색하다.

AI의 목표는 당연히 더 똑똑해지는 것 아닌가? 성능을 올리는 것이 아니라 효율을 이야기한다는 게 직관적으로 와닿지 않는다.

그런데 논문을 조금만 더 따라가 보면, 이 말이 왜 나왔는지 이해가 된다.

지금의 AI 시스템을 실제로 구성하는 요소를 보면, 우리가 생각하는 것과는 조금 다른 현실이 드러난다.

우리는 보통 GPU 연산량이나 모델 파라미터 수 같은 것을 중심으로 생각하지만, 실제 비용 구조는 거기에 있지 않다.

데이터를 메모리에서 가져오고, 다시 저장하고, 네트워크로 이동시키는 과정이 훨씬 더 큰 비용을 만들어낸다.

즉, 문제는 “얼마나 많이 계산하느냐”가 아니라 “데이터를 어떻게 움직이느냐”에 더 가깝다.

이 지점에서 자연스럽게 하나의 결론이 나온다.

AI는 더 이상 단순한 알고리즘 문제가 아니라, 시스템 문제라는 것이다.

논문에서도 이걸 굉장히 강하게 표현한다. AI와 하드웨어는 더 이상 분리될 수 없다는 이야기다.

모델만 따로 발전시키고, 칩은 따로 발전시키고, 시스템은 나중에 붙이는 방식으로는 더 이상 효율을 끌어올릴 수 없다는 것이다.

전체를 하나의 구조로 보고 같이 설계해야 한다.

여기까지 보면 약간 비관적으로 들릴 수도 있다.

“그럼 지금 방식은 끝난 건가?”라는 생각이 자연스럽게 따라온다. 나도 처음에는 그렇게 느꼈다.

그런데 이건 “끝났다”의 문제가 아니라, “이대로는 안 된다”에 더 가깝다.

AI는 계속 발전한다. 다만 지금처럼 모델을 계속 키우는 방식만으로는 그 발전을 유지할 수 없다는 것이다.

논문에서 말하는 것처럼, 앞으로는 같은 성능을 훨씬 적은 에너지로 내는 방향, 즉 효율 중심으로 구조를 바꿔야 한다.

이걸 조금 더 현실적으로 풀어보면, 지금 우리는 이런 상황에 있다.

모델은 계속 좋아지고 있지만, 그 대가로 들어가는 비용도 같이 폭발하고 있다.

전력 사용량은 증가하고, 메모리 병목은 더 심해지고, 시스템은 점점 복잡해진다.

단순히 “더 좋은 모델을 만들자”는 접근으로는 이 문제를 해결할 수 없다.

여기서 나는 한 가지를 더 떠올렸다. 데이터다.

요즘 AI 환경을 보면, 데이터의 성격 자체도 바뀌고 있다.

과거에는 사람이 만든 데이터가 대부분이었지만, 이제는 AI가 생성한 데이터가 점점 더 큰 비중을 차지한다. 문제는 이 데이터가 다시 학습에 들어간다는 점이다.

이 구조가 반복되면 어떤 일이 생길까?

- 정보의 다양성은 줄어들고

- 특정 패턴이 과도하게 강화되며, 결국 모델이 점점 왜곡될 수 있다.

이걸 설명하는 개념이 바로 model collapse다. 아직 완전히 해결된 문제는 아니지만, 분명히 방향성 자체는 위험 신호를 보여주고 있다.

이쯤 되면 그림이 하나 그려진다.

모델은 계속 좋아지지만, 비용은 커지고, 데이터는 불안정해지고, 시스템은 복잡해진다. 그리고 이 모든 문제는 결국 하나의 질문으로 이어진다.

“이 상태에서 우리는 무엇을 해야 할까?”

나는 여기서 방향이 바뀐다고 생각한다.

더 큰 모델을 만드는 것이 아니라, 이미 충분히 좋은 모델을 어떻게 사용할 것인가로 초점이 이동한다.

이 지점에서 등장하는 개념이 바로 Agentic AI와 하네스이다.

Agentic AI와 하네스는 새로운 모델이 아니다.

이건 구조다. 하나의 모델이 모든 것을 해결하는 대신, 여러 모델과 도구를 연결하고, 상태를 유지하고, 작업을 나눠서 처리하는 방식이다.

쉽게 말하면, AI를 하나의 “지능”이 아니라 “작업 시스템”으로 사용하는 접근이다.

이걸 기존 방식과 비교해보면 차이가 더 명확해진다.

기존에는 사용자가 질문을 던지면 모델이 답을 생성하는 구조였다.

하지만 Agentic 구조에서는 그 사이에 하나의 오케스트레이션 레이어가 들어간다.

작업을 나누고, 필요한 도구를 선택하고, 중간 결과를 저장하고, 다시 다음 단계로 이어가는 흐름이 만들어진다.

이건 단순한 아키텍처 변화가 아니다.

AI의 역할 자체가 바뀌는 것이다. 더 이상 “답을 생성하는 도구”가 아니라, 실제로 일을 수행하는 시스템이 된다.

여기서 다시 논문으로 돌아가 보면 흥미로운 지점이 있다.

논문은 Agentic AI를 직접적으로 언급하지는 않지만, 요구하는 방향은 완전히 동일하다.

전체 스택을 재설계하고, 효율 중심으로 최적화하며, 시스템 단위로 AI를 바라보라는 것.

이건 결국 모델을 하나의 컴포넌트로 보고, 전체 시스템 안에서 조합하는 방식으로 가야 한다는 의미다.

그래서 나는 이렇게 해석하게 됐다.

Agentic AI는 새로운 트렌드가 아니라, 이 변화의 자연스러운 결과라는 것이다.

중요한 건 이거다.

Agentic AI는 성능이 부족해서 나온 것이 아니다.

오히려 반대다. 성능이 충분히 확보되었기 때문에, 이제 그 성능을 “어떻게 활용할 것인가”라는 단계로 넘어온 것이다.

결국 우리가 보고 있는 변화는 이런 흐름이다.

모델을 키우는 경쟁에서, 시스템을 설계하는 경쟁으로. 성능을 높이는 경쟁에서, 효율과 실행력을 높이는 경쟁으로.

그래서 처음 질문으로 돌아가 보면, 답은 조금 달라진다.

AI는 한계에 도달한 것이 아니다. 다만 우리가 익숙하게 사용하던 발전 방식이 더 이상 유효하지 않게 된 것이다.

이제 중요한 것은 “얼마나 똑똑한가”가 아니라, “얼마나 일을 잘 수행하는가”다.

그리고 그 전환의 첫 번째 형태가 바로 지금 우리가 보고 있는 Agentic AI다.

결국 우리가 원하는 건 하나일지도 모른다.

더 똑똑한 AI가 아니라, 실제로 일을 대신해주는 AI.

그리고 지금의 변화는, 정확히 그 방향으로 가고 있다.